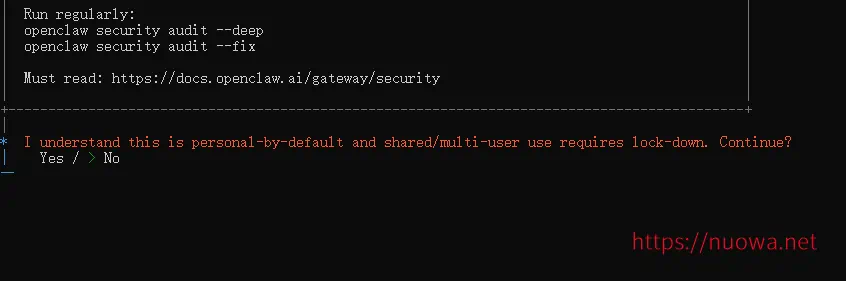

gpt_academic支持API方式调用各种在线大语言模型如ChatGPT等,但是有些人可能没有在线大模型的API,或是想使用本地电脑部署的大语言模型,gpt_academic是支持调用本地电脑上安装的大语言模型的,本次以阿里通义千问大语言模型Qwen/Qwen-1_8B-Chat-Int8为例进行演示安装完整操作步骤。

首先将项目源码git到本地电脑上,终端窗口中运行如下命令:

git clone https://github.com/binary-husky/gpt_academic.git然后cd进项目文件夹内安装依赖:

pip install -r requirements.txt然后再运行下面命令安装Qwen_Local的依赖:

pip install -r request_llms/requirements_qwen_local.txt使用本地模型还需要安装einops库,因为默认没有安装,运行时会报错缺少,运行如下命令安装:

pip install einops默认安装的transformers版本等级过高,运行时会报错TypeError: isin() received an invalid combination of arguments – got (elements=Tensor, test_elements=int, ), but expected one of,所以你需要重新安装transformers,将版本降低到4.41.0以下

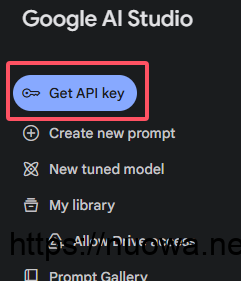

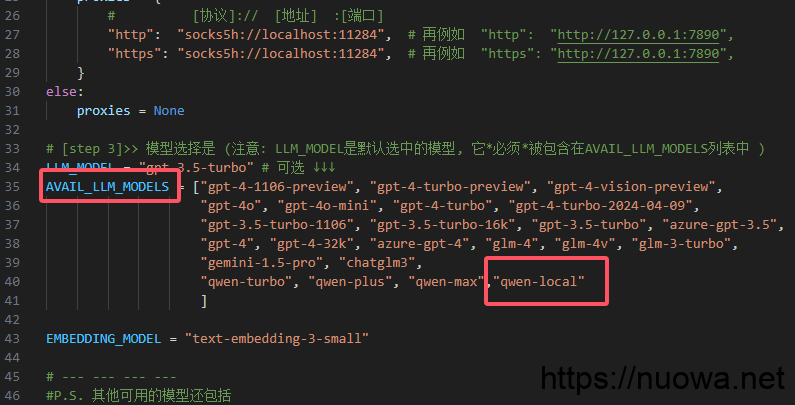

打开config.py文件,将35行左右的代码,AVAIL_LLM_MODELS内增加”qwen-local”,添加这一项的话在webUI中就可以选择本地大语言模型,

这样就初步完成了,运行下面命令启动webUI界面:

python main.py

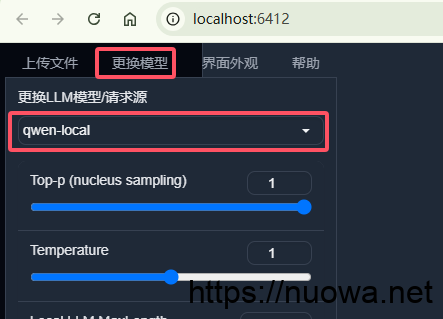

在页面左上角【更换模型】中,可以选择qwen-local,在右侧输入区输入文本和大模型对话,第一次会自动下载模型文件

模型下载完成后即可使用gpt_academic完整功能

如果你不懂代码,不会自己部署的话,你可以使用我制作的一键启动整合包,看我另一篇文章介绍:《PDF/LaTex论文翻译、润色、总结gpt_academic整合包,PDF/Markdown翻译》

相关推荐

最近更新

AI漫剧制作即梦seedance2.0教程及提示词2026年5月最新版分享

AI视频依旧持续火爆,各种类型的AI视频层出不穷,视频效果也是越来越好,甚至快接近影视级,目前最主要的AI视频生成工具还是即梦,即梦 Seedance 2.0生成视频一秒钟都到2块多钱了😂,不过也没办法,还是得用,目前还没能有替代即梦see...

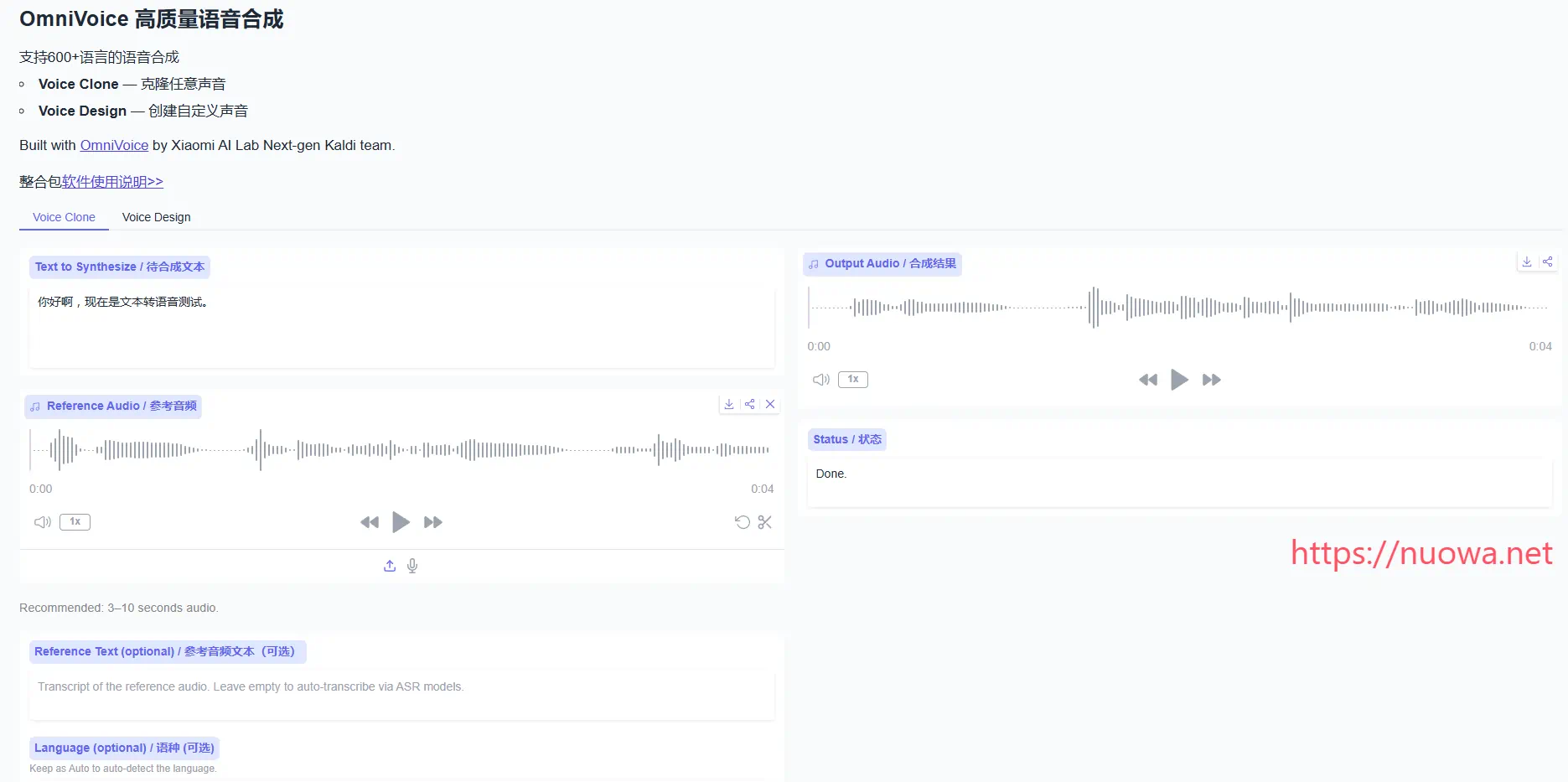

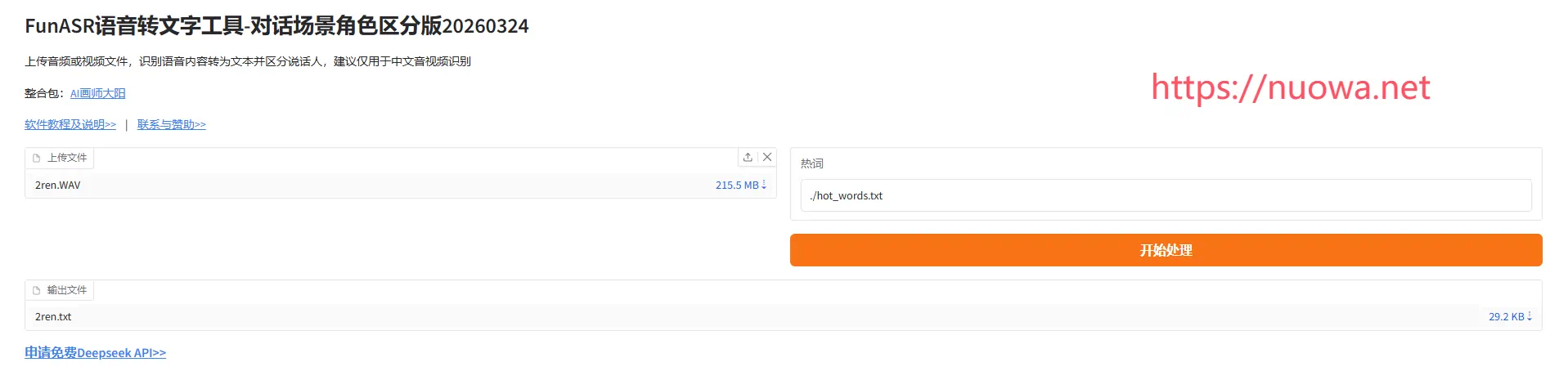

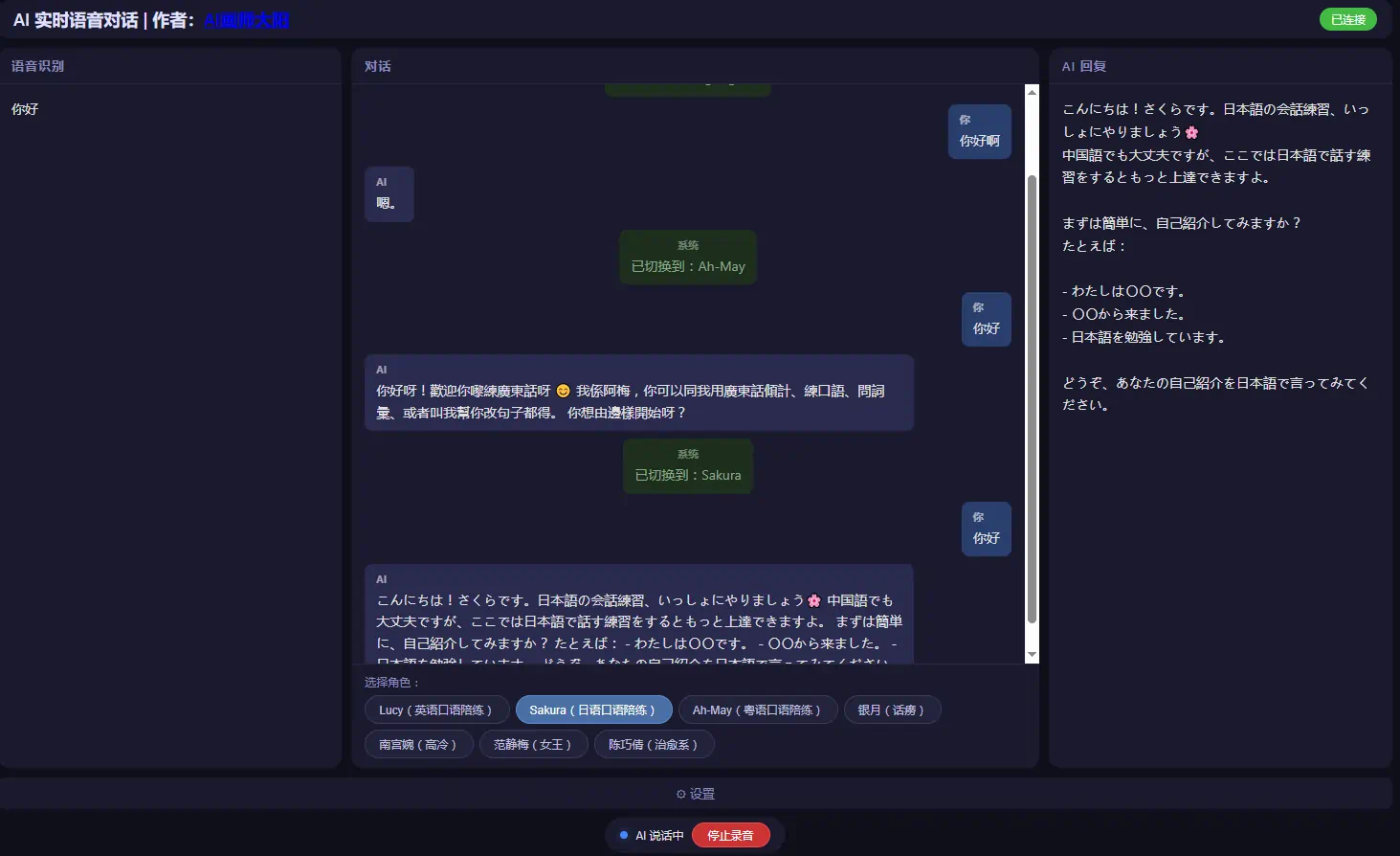

AI实时语音聊天对话系统,外语口语陪练/虚拟好友实时语音交流

AI 实时语音对话系统 是一款集语音识别(ASR)、大语言模型(LLM)对话、语音合成(TTS)于一体的实时语音交互软件。用户通过麦克风说话,系统自动识别语音内容并转为文字,交由 AI 角色进行智能回复,最终将回复内容合成为语音实时播放,实...

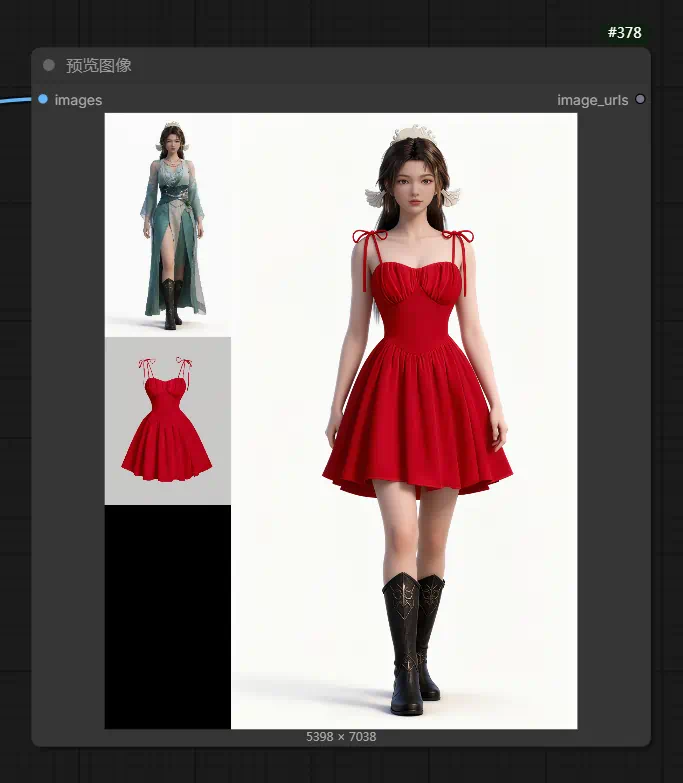

ComfyUI 三参考图生图工作流,虚拟试衣、换脸、图片内容整合

本工作流核心能力是将三张不同角度、内容的参考图,通过 AI 理解融合,生成一张新的图像,新图像内容根据描述词指令生成。工作流集成了阿里巴巴的 Qwen2.5-VL 多模态大模型(图像编辑版本)与 SeedVR2 超分辨率放大模型,实现了「理...

comfyui CUDA128+torch 2.8.0+python3.12最新纯净版一键启动整合包

comfyui官方发布的最新版便携包是基于torch 2.11+CU130 +Python 3.13版本制作的,Python版本和torch版本都太新了,windows电脑上安装某些节点的时候会有冲突报错,有时候就算能安装上也会比较麻烦,感...

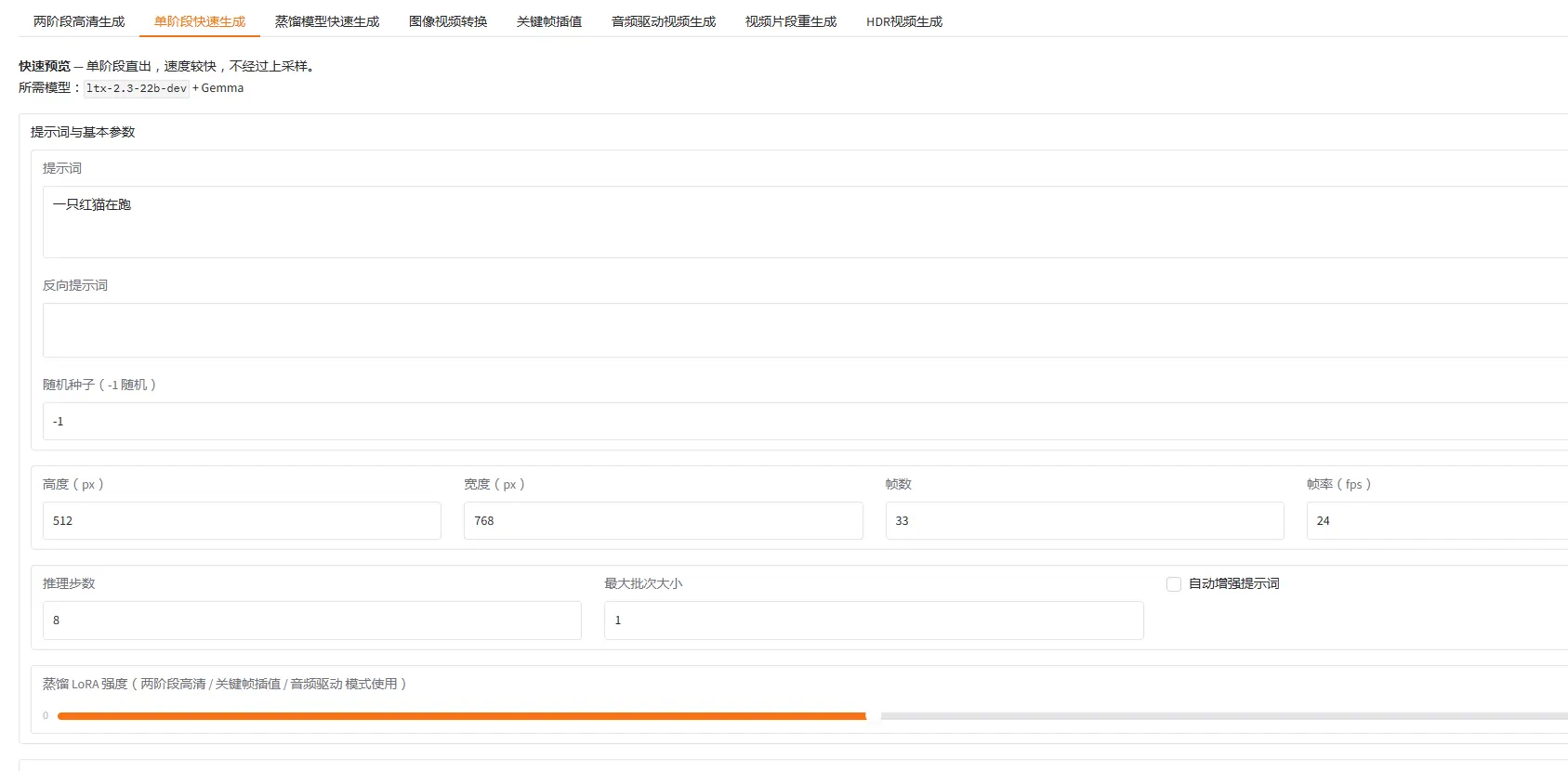

LTX2.3+comfyui音频驱动视频生成工作流

这是一个基于 ComfyUI 的 LTX 2.3 音视频同步生成工作流,核心功能是上传一段音频 + 参考图片(可多张图),自动生成与音频内容对应的视频,适合制作人物说话、唱歌等口型同步视频。工作流使用8位量化版ltx2.3模型,显存需求降低...

LTX2.3+comfyui分段提示词图片转视频工作流,AI视频带货生成器

再和大家分享一个基于 ComfyUI 的 AI 分段提示词图生视频工作流,本工作流主要基于模型LTX2.3和PromptRelay实现。可使用PromptRelay分时段控制生成不同视频画面或合成语音内容。 📌 工作流简介 本工作流是一套基...

windows电脑C盘垃圾查找清理软件

电脑用了好几年了,尽管我安装软件从来不主动装到C盘,偶尔也会清理垃圾,但是用的久了,容量也是在慢慢减少。我C盘303G,现在就剩了24G了,已经会影响到系统性能和虚拟内存调度了,已经不能不管了。C盘不装软件的话大多都是缓存,文件太多了,有时...

LTX2.3+comfyui视频去除字幕水印工作流分享

本次再和大家分享一个视频去字幕水印的comfyui工作流,工作流基于LTX2.3视频生成模型制作。LTX2.3是最新最强的视频生成模型,我前段时间就分享过了,可以看我另一篇文章:https://nuowa.net/2525,comfyui项...

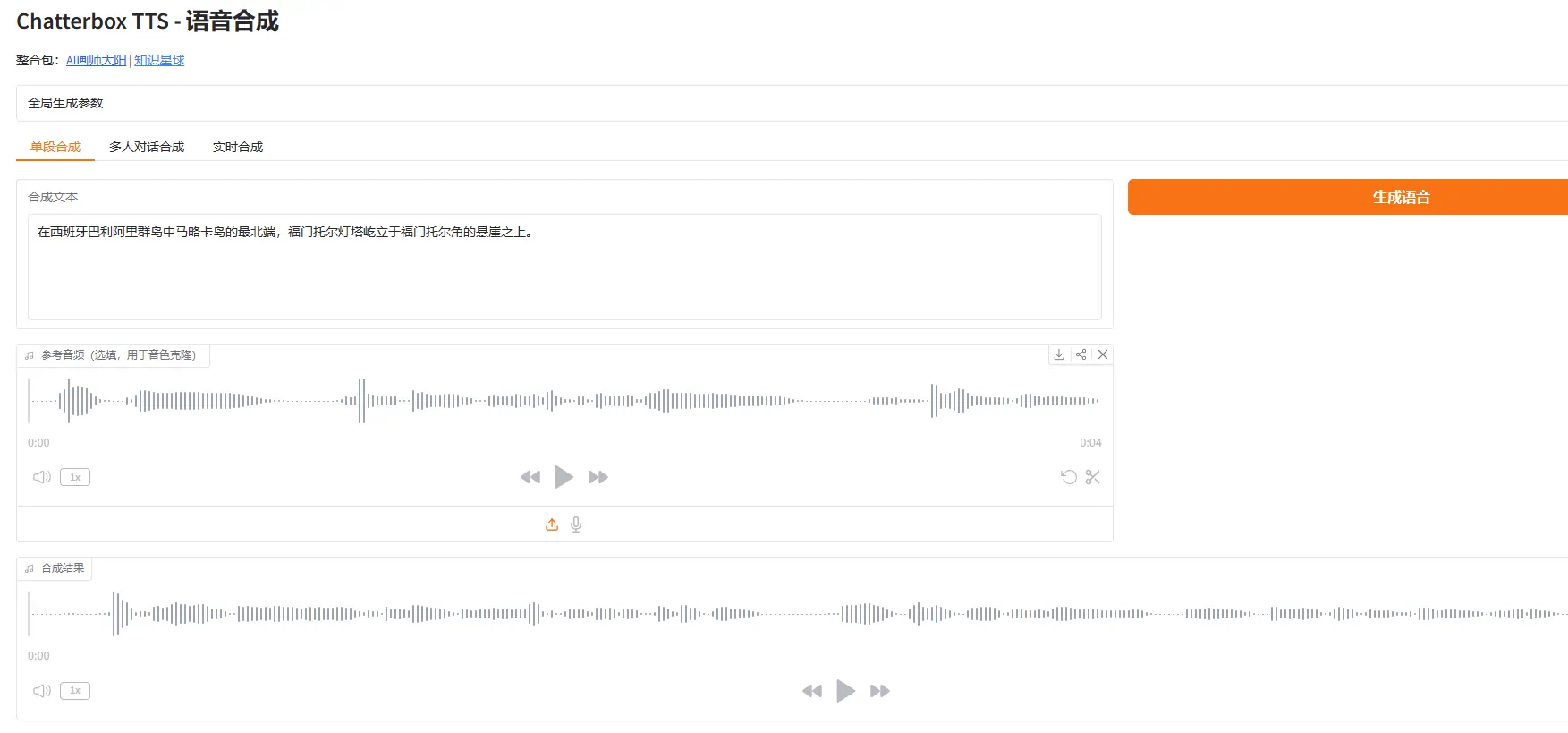

多人对话声音克隆语音合成工具Chatterbox TTS免安装版,AI实时文字转语音

Chatterbox 是由 Resemble AI 开发的开源文本转语音(Text-to-Speech, TTS)模型,支持零样本音色克隆:只需提供一段参考音频(几秒钟的人声),即可模仿该音色朗读任意文本。我基于最新版源码制作了免安装一键启...

Mineru PDF转markdown软件局域网版

对于有的电脑配置比较低或是win7系统等电脑无法使用Mineru情况,可以使用局域网内可运行软件的电脑运行Mineru,然后其它电脑或手机等终端输入IP地址,打开运行软件的IP地址来使用Mineru。 具体用法: 下载局域网版压缩包到本地电...