xFormers

xFormers 是一个由 Facebook AI Research (FAIR) 开发的开源库,专注于高效实现 Transformer 模型中的各种组件。它旨在优化 Transformer 模型的训练和推理效率,特别是在大规模数据集和模型上。

主要特点:

- 模块化设计:xFormers 提供了多种 Transformer 模块的灵活实现,如注意力机制、前馈网络等。

- 高效实现:通过优化内存使用和计算效率,xFormers 能够加速训练和推理过程。

- 支持多种硬件:xFormers 支持 CPU 和 GPU,并且针对 NVIDIA GPU 进行了特别优化。

- 研究友好:xFormers 提供了丰富的实验工具和接口,方便研究人员进行模型设计和实验。

应用场景:

- 自然语言处理 (NLP)

- 计算机视觉 (CV)

- 多模态学习

Flash-Attention

Flash-Attention 是一种高效的自注意力机制实现,旨在减少内存占用和计算复杂度,同时保持模型的性能。它通过优化注意力机制中的矩阵运算,显著提升了 Transformer 模型的训练和推理速度。

主要特点:

- 内存效率:Flash-Attention 通过减少中间结果的存储需求,显著降低了内存占用。

- 计算效率:通过优化矩阵乘法和 softmax 操作,Flash-Attention 减少了计算复杂度,提升了计算速度。

- 可扩展性:Flash-Attention 适用于大规模模型和数据集,能够有效处理长序列输入。

应用场景:

- 大规模 Transformer 模型训练

- 长序列处理任务,如文档分类、长文本生成

对比

| 特性 | xFormers | Flash-Attention |

|---|---|---|

| 目标 | 提供高效的 Transformer 组件实现 | 优化自注意力机制的内存和计算效率 |

| 主要优化 | 模块化设计、内存和计算优化 | 内存和计算效率 |

| 适用场景 | 通用 Transformer 模型 | 大规模模型和长序列处理 |

| 硬件支持 | CPU、GPU | GPU |

| NVIDIA平台 | 系列通用 | 30XX或40XX系列 |

xFormers 和 Flash-Attention 都是旨在提升 Transformer 模型效率的工具。xFormers 提供了广泛的 Transformer 组件优化,适用于多种任务和硬件平台;而 Flash-Attention 则专注于自注意力机制的高效实现,特别适合处理大规模模型和长序列任务。两者可以结合使用,以进一步提升 Transformer 模型的性能。

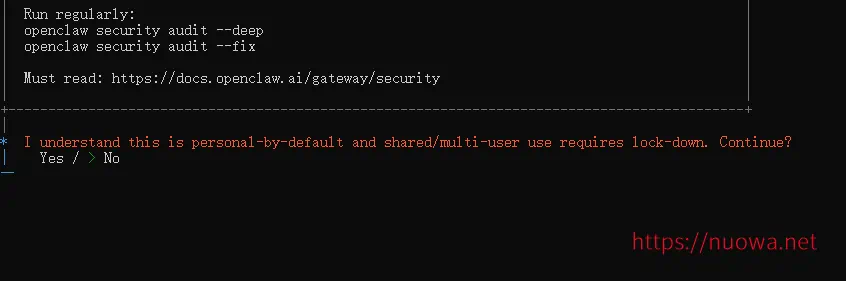

另外说明:

xFormers兼容性更广一些,Flash-Attention用不了时应用就需要使用xFormers来加速,有些应用支持Flash-Attention和xFormers切换,我们可以通过设置环境变量的值来选择使用哪个工具来加速。

将环境变量的值“ATTN_BACKEND”设置为“xformers”,就可以将应用默认加速工具选择为了“xformers”

相关推荐

Python gradio应用启动后局域网内其它电脑访问使用开启端口方法

Python gradio应用启动后局域网内其它电脑访问使用开启端口方法 cannot load library 'libcairo-2.dll': error 0x7e. Additionally,

cannot load library 'libcairo-2.dll': error 0x7e. Additionally, model = whisperx.load_model(卡住,程序崩溃闪退

model = whisperx.load_model(卡住,程序崩溃闪退 Processing failed:'DINOv3ViTModel' object has no attribute 'layer'

Processing failed:'DINOv3ViTModel' object has no attribute 'layer' Python免费翻译工具库,Google,Bing,百度翻译接口用法

Python免费翻译工具库,Google,Bing,百度翻译接口用法 使用Nuitka将Python应用打包为windows的exe程序具体方法

使用Nuitka将Python应用打包为windows的exe程序具体方法 HuggingFace模型压缩打包时符号链接引起的文件夹过大问题解决方法

HuggingFace模型压缩打包时符号链接引起的文件夹过大问题解决方法 AttributeError: module 'torch.library' has no attribute 'register_fake'

AttributeError: module 'torch.library' has no attribute 'register_fake'

最近更新

AI漫剧制作即梦seedance2.0教程及提示词2026年5月最新版分享

AI视频依旧持续火爆,各种类型的AI视频层出不穷,视频效果也是越来越好,甚至快接近影视级,目前最主要的AI视频生成工具还是即梦,即梦 Seedance 2.0生成视频一秒钟都到2块多钱了😂,不过也没办法,还是得用,目前还没能有替代即梦see...

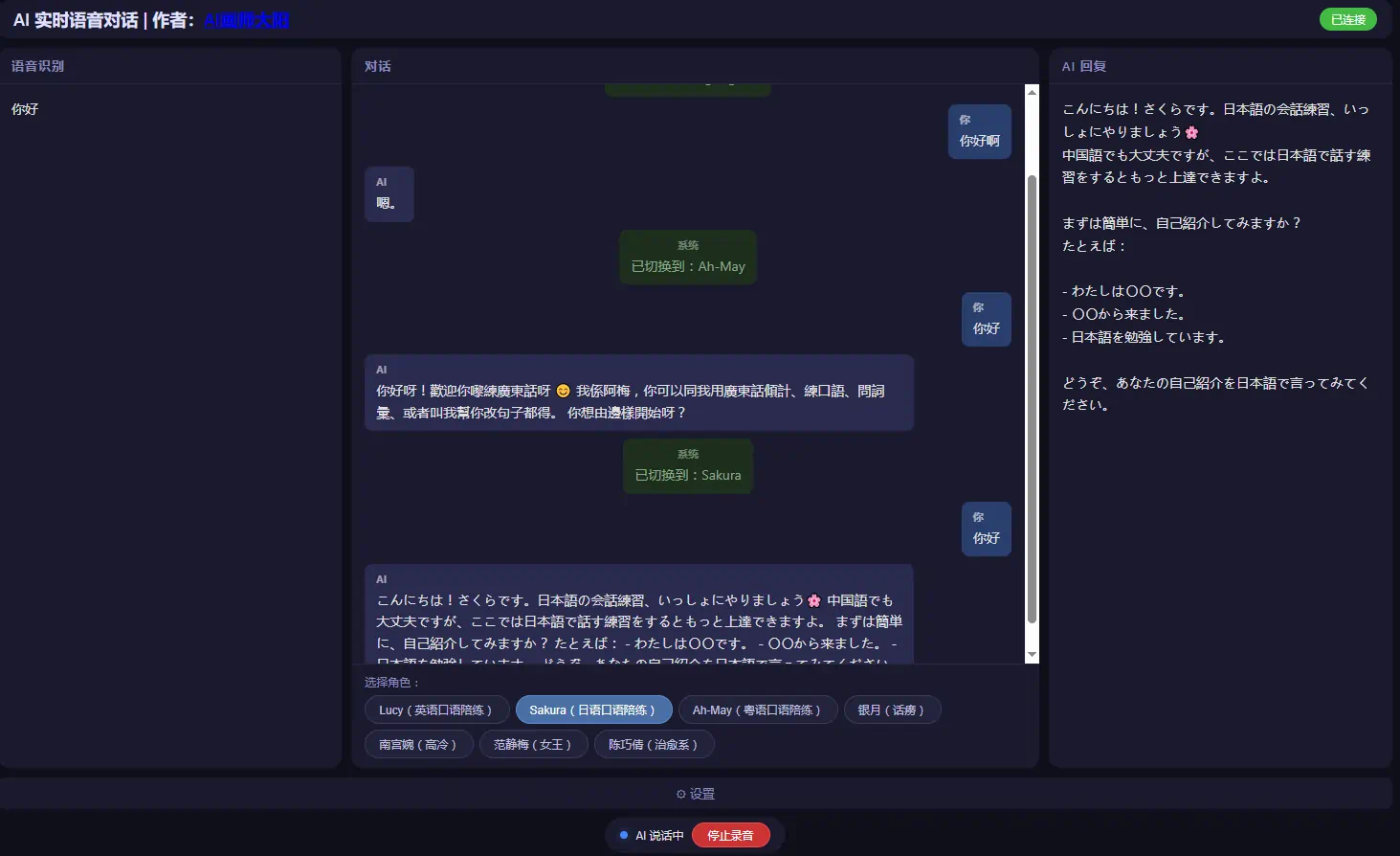

AI实时语音聊天对话系统,外语口语陪练/虚拟好友实时语音交流

AI 实时语音对话系统 是一款集语音识别(ASR)、大语言模型(LLM)对话、语音合成(TTS)于一体的实时语音交互软件。用户通过麦克风说话,系统自动识别语音内容并转为文字,交由 AI 角色进行智能回复,最终将回复内容合成为语音实时播放,实...

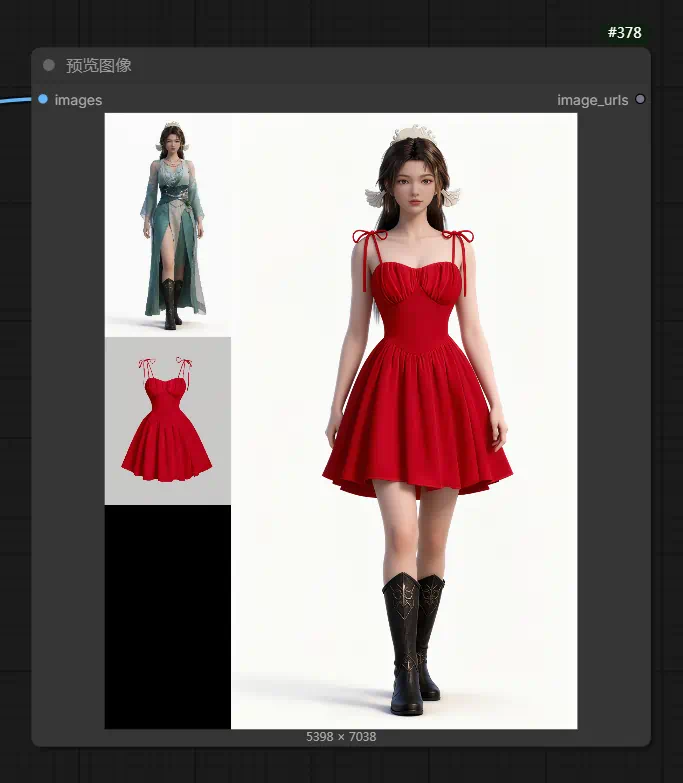

ComfyUI 三参考图生图工作流,虚拟试衣、换脸、图片内容整合

本工作流核心能力是将三张不同角度、内容的参考图,通过 AI 理解融合,生成一张新的图像,新图像内容根据描述词指令生成。工作流集成了阿里巴巴的 Qwen2.5-VL 多模态大模型(图像编辑版本)与 SeedVR2 超分辨率放大模型,实现了「理...

comfyui CUDA128+torch 2.8.0+python3.12最新纯净版一键启动整合包

comfyui官方发布的最新版便携包是基于torch 2.11+CU130 +Python 3.13版本制作的,Python版本和torch版本都太新了,windows电脑上安装某些节点的时候会有冲突报错,有时候就算能安装上也会比较麻烦,感...

LTX2.3+comfyui音频驱动视频生成工作流

这是一个基于 ComfyUI 的 LTX 2.3 音视频同步生成工作流,核心功能是上传一段音频 + 参考图片(可多张图),自动生成与音频内容对应的视频,适合制作人物说话、唱歌等口型同步视频。工作流使用8位量化版ltx2.3模型,显存需求降低...

LTX2.3+comfyui分段提示词图片转视频工作流,AI视频带货生成器

再和大家分享一个基于 ComfyUI 的 AI 分段提示词图生视频工作流,本工作流主要基于模型LTX2.3和PromptRelay实现。可使用PromptRelay分时段控制生成不同视频画面或合成语音内容。 📌 工作流简介 本工作流是一套基...

windows电脑C盘垃圾查找清理软件

电脑用了好几年了,尽管我安装软件从来不主动装到C盘,偶尔也会清理垃圾,但是用的久了,容量也是在慢慢减少。我C盘303G,现在就剩了24G了,已经会影响到系统性能和虚拟内存调度了,已经不能不管了。C盘不装软件的话大多都是缓存,文件太多了,有时...

LTX2.3+comfyui视频去除字幕水印工作流分享

本次再和大家分享一个视频去字幕水印的comfyui工作流,工作流基于LTX2.3视频生成模型制作。LTX2.3是最新最强的视频生成模型,我前段时间就分享过了,可以看我另一篇文章:https://nuowa.net/2525,comfyui项...

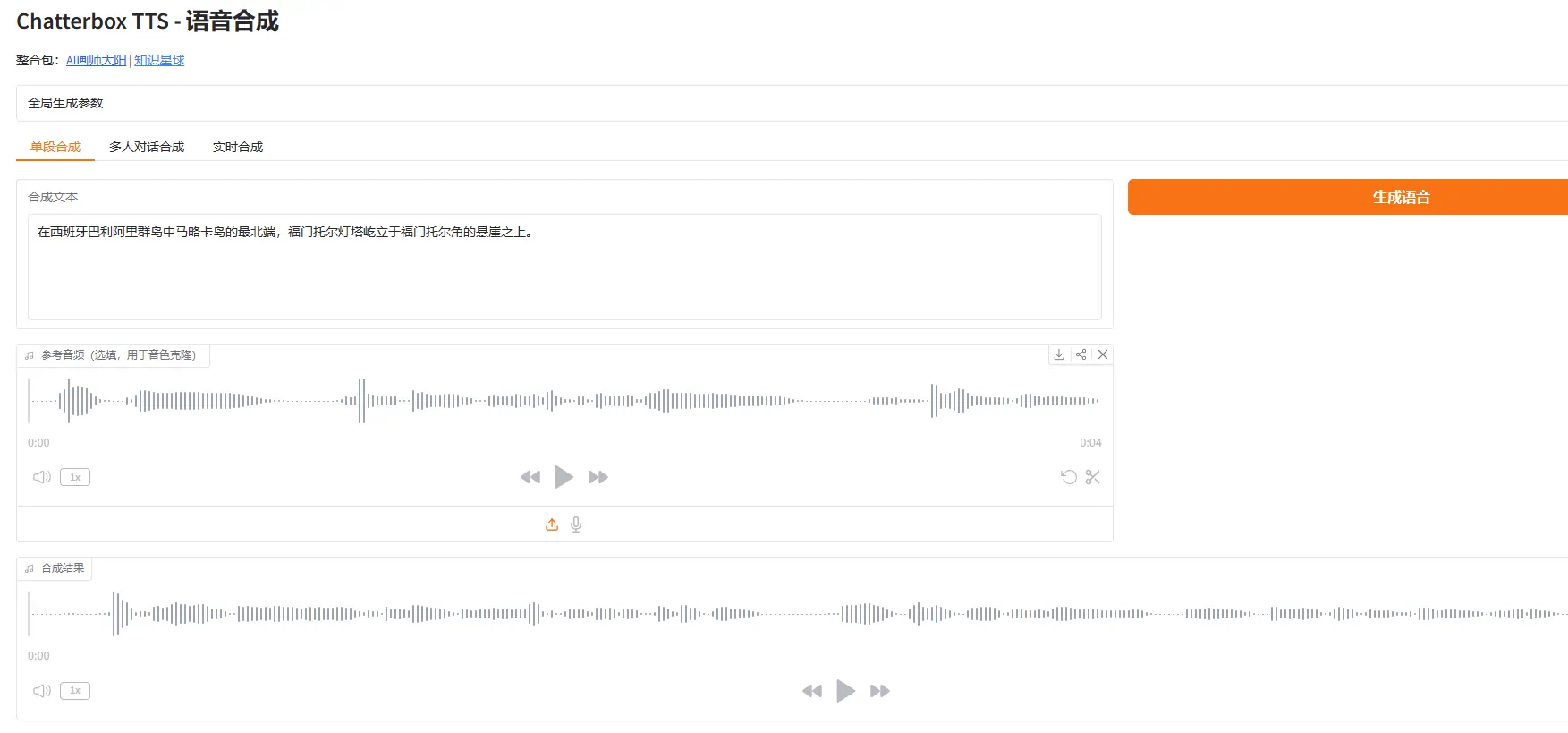

多人对话声音克隆语音合成工具Chatterbox TTS免安装版,AI实时文字转语音

Chatterbox 是由 Resemble AI 开发的开源文本转语音(Text-to-Speech, TTS)模型,支持零样本音色克隆:只需提供一段参考音频(几秒钟的人声),即可模仿该音色朗读任意文本。我基于最新版源码制作了免安装一键启...

Mineru PDF转markdown软件局域网版

对于有的电脑配置比较低或是win7系统等电脑无法使用Mineru情况,可以使用局域网内可运行软件的电脑运行Mineru,然后其它电脑或手机等终端输入IP地址,打开运行软件的IP地址来使用Mineru。 具体用法: 下载局域网版压缩包到本地电...