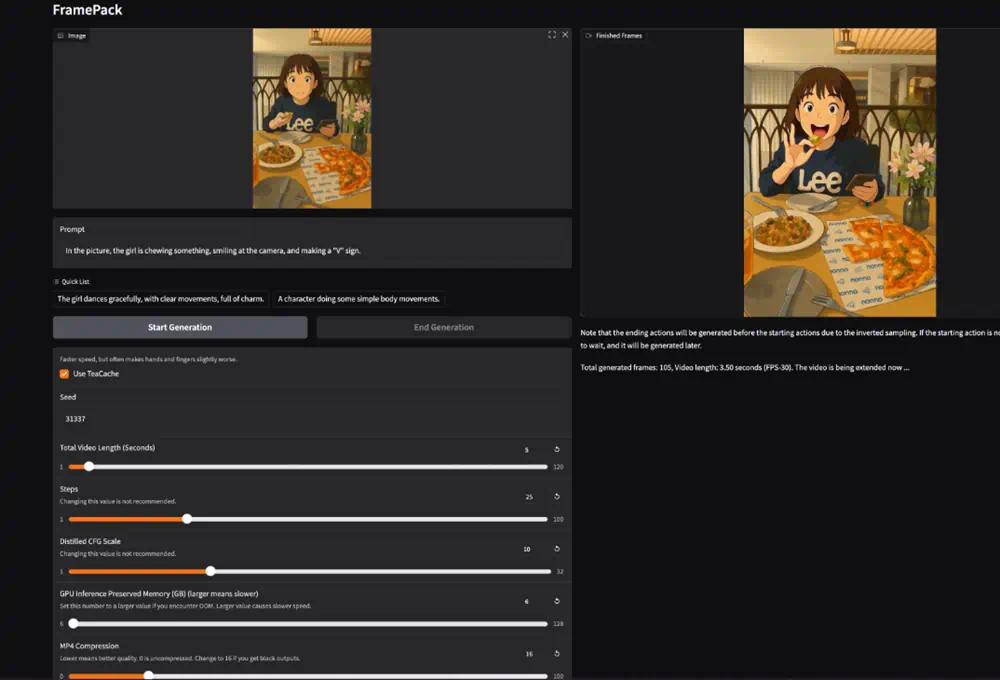

前段时间阿里开源了一个AI视频生成工具WAN2.1,可以实现文本转视频和图片转视频,虽说很强大,但是测试之后感觉软件对电脑配置要求太高了,感觉应该大部分用户都用不了,而且只支持720P视频,清晰度有些低,所以没和大家分享。前些天又出了一个更牛的AI视频生成软件FramePack,这个软件英伟达显卡显存6G即可体验,远远降低了使用门槛,我基于当前最新版本制作了一键启动整合包。

FramePack介绍

FramePack 是一个渐进式生成视频的下一帧(下一帧部分)预测神经网络结构。

FramePack 将输入上下文压缩为恒定长度,以便生成工作量不受视频长度的影响。

即使在笔记本电脑 GPU 上,FramePack 也可以使用 13B 模型处理大量帧。

FramePack 可以使用更大的批量大小进行训练,类似于图像扩散训练的批量大小。

视频扩散,但感觉像图像扩散。

FramePack-F1

FramePack-F1是一种仅通过历史帧预测未来帧的FramePack模型。

“F1″代表”前向”版本1,表明其预测方向(该模型仅进行正向预测,而非反向预测)。这种单向预测模型相比默认的双向模型具有更少的约束条件,因此能呈现更大的变化幅度和更丰富的动态效果。像提示词穿梭这类应用场景应该会获得更佳效果。

但构建此类模型的主要挑战在于如何防止视频生成过程中出现漂移现象(或称误差累积)。该模型采用了一项新型抗漂移调控技术进行训练,相关论文将很快在Arxiv平台更新。

FramePack整合包使用教程

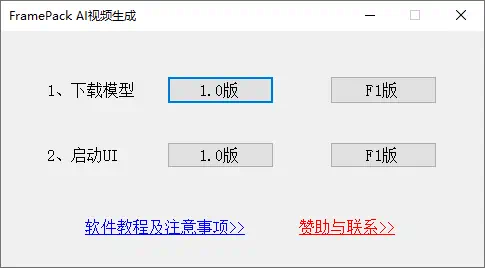

首先将网盘内的软件压缩包下载到本地电脑上并解压,首先需要下载模型,先点击下载模型后面1.0按钮下载模型,如果你想使用F1版,也需要先下载1.0版模型,然后再下载F1版模型。模型非常大,超过了40G,如果下载所有版本模型文件的话,总共硬盘空间占用约65G。

模型从魔塔站点下载,国内速度非常快,不会需要太久,等到黑色终端窗口里输出模型下载完成提示信息的时候,就是下载完成了,如果没提示输出下载完成信息的话就是没下载完,如果报错终止的话,可以重新运行下载程序继续接着之前进度下载。

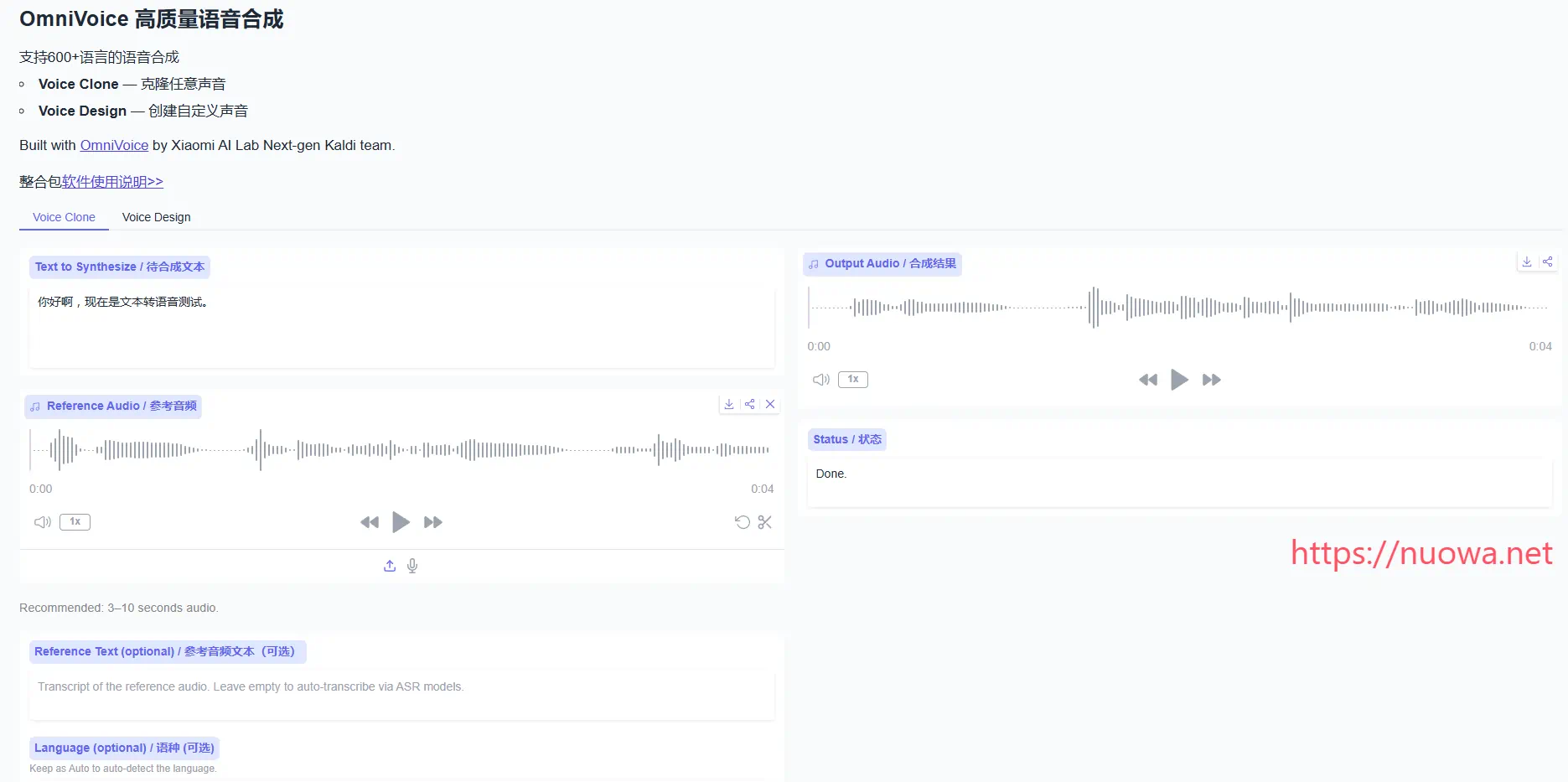

点击按钮启动webUI,启动时会加载模型,请耐心等待,启动完成后会自动打开webui界面。

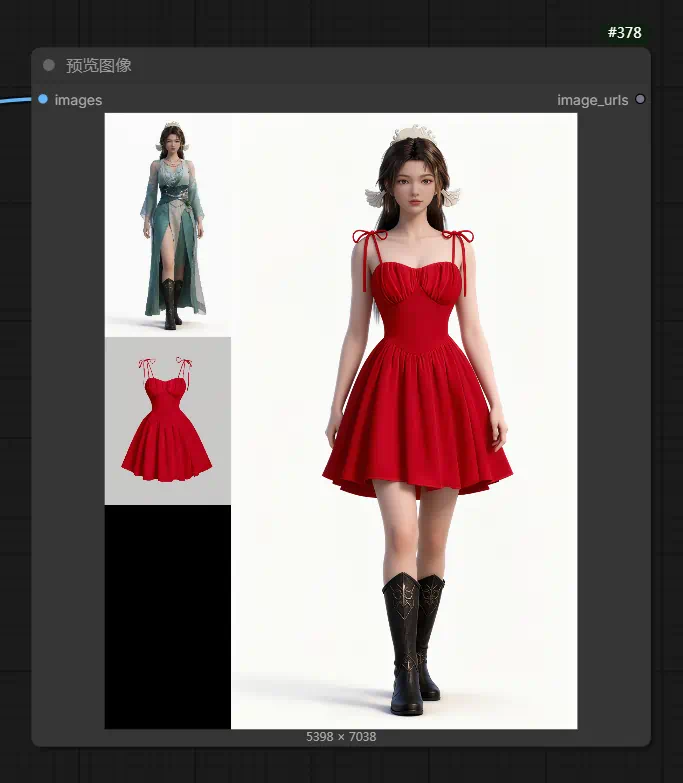

先上传一张参考图片,然后在prompt提示词输入框里输入想要生成视频的画面内容描述,然后点击start generate 开始合成视频。

默认视频时长是5秒,最大可生成120秒视频,可通过参数Total Video Length (Seconds)设置。

其它参数保持默认即可

整合包修改内容:

增加了对20系列显卡的支持

模型下载站点由原来国外的huggingface改为国内的魔塔,方便国内用户使用

其它部分细节上的修改

注意事项

虽然官方文档说明6G显存可用,但是速度极慢,建议英伟达显卡显存6G以上用户体验

内存大于32G

只支持windows10或11

软件运行路径中不要有非英文字符和空格,待处理文件同样要注意

免费AI视频生成软件FramePack下载链接

相关推荐

BiliNote:自动生成B站油管视频笔记,AI视频内容总结工具

BiliNote:自动生成B站油管视频笔记,AI视频内容总结工具 优云智算HappyHorse AI 视频生成API KEY WebUI

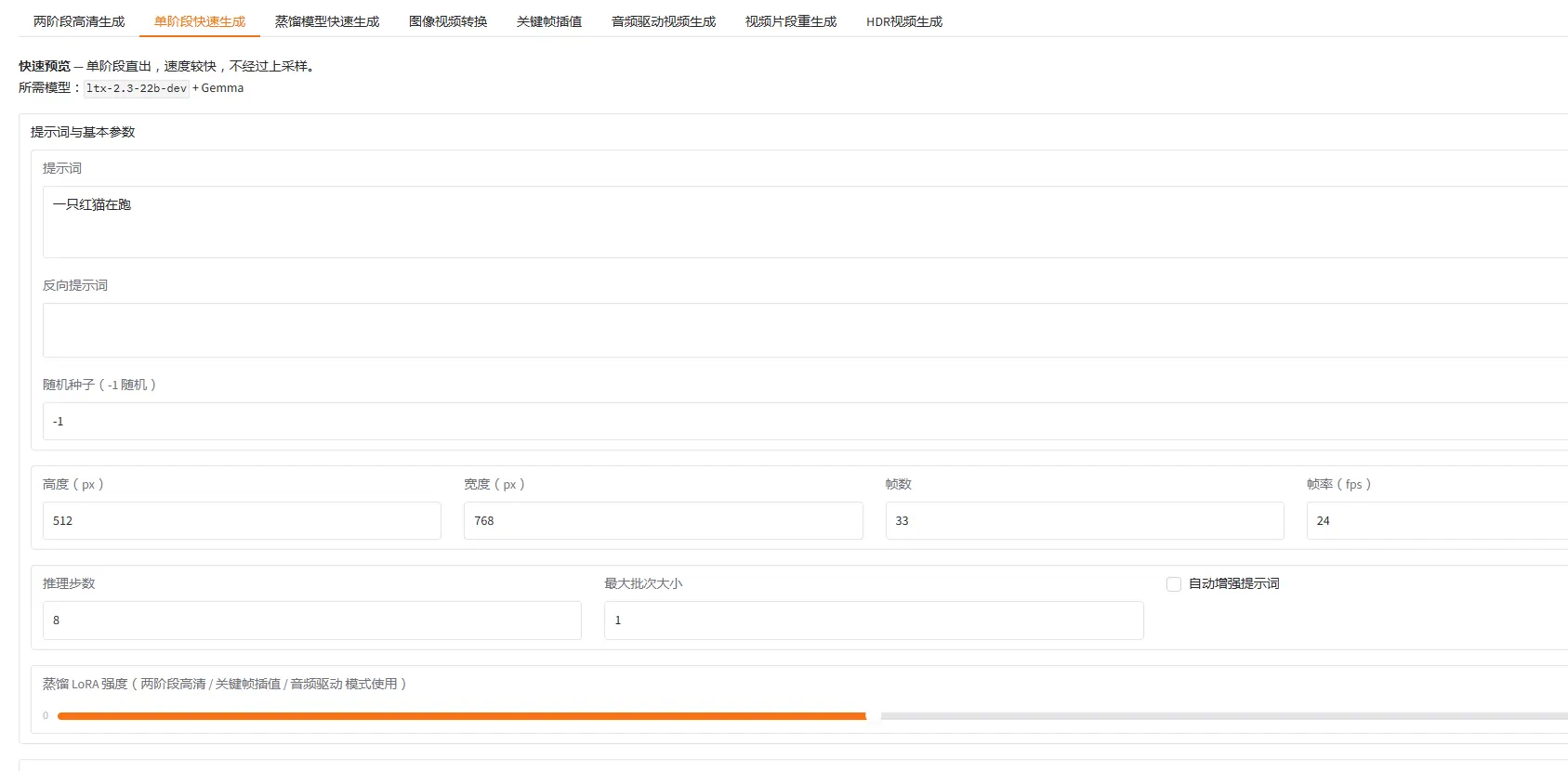

优云智算HappyHorse AI 视频生成API KEY WebUI LTX-2.3 视频生成免安装部署整合包软件下载

LTX-2.3 视频生成免安装部署整合包软件下载 FlashVSR低分辨率模糊视频高清放大工具整合包v1.1下载,免安装一键启动

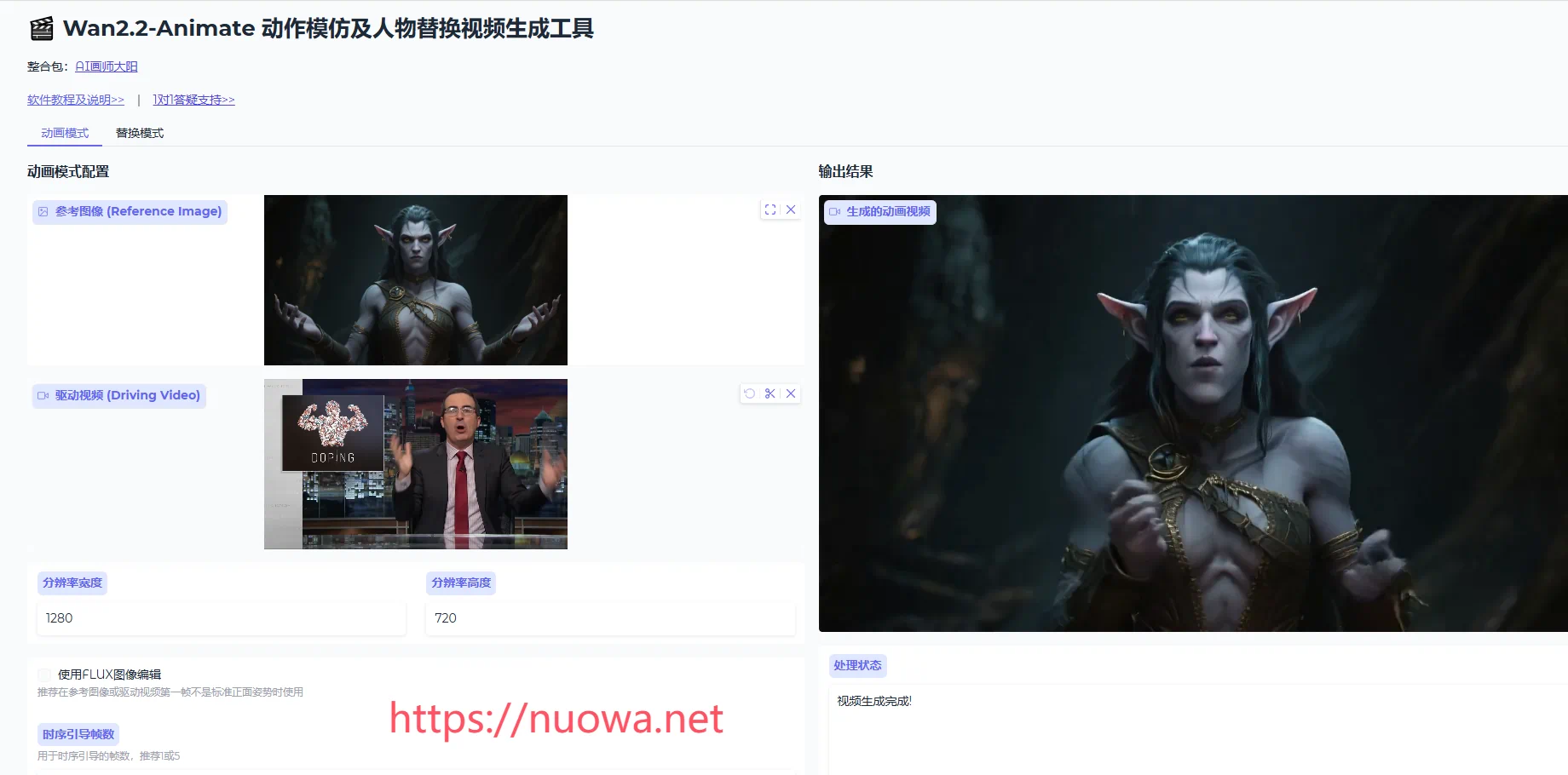

FlashVSR低分辨率模糊视频高清放大工具整合包v1.1下载,免安装一键启动 人物动作迁移及视频人物替换软件Wan2.2-Animate-14B整合包下载,动作模仿视频换主体工具在线一键启动

人物动作迁移及视频人物替换软件Wan2.2-Animate-14B整合包下载,动作模仿视频换主体工具在线一键启动 无限长度的数字人对话视频生成软件InfiniteTalk整合包,图像转视频、视频配音对口型工具

无限长度的数字人对话视频生成软件InfiniteTalk整合包,图像转视频、视频配音对口型工具 Wan2.2-S2V-14B:音频驱动图片转视频生成本地整合包及在线一键启动

Wan2.2-S2V-14B:音频驱动图片转视频生成本地整合包及在线一键启动 2D照片转3D视频软件stable-virtual-camera免安装一键启动整合包下载

2D照片转3D视频软件stable-virtual-camera免安装一键启动整合包下载

最近更新

免费在线HTML转markdown工具

经常看一些在线文档,想复制给AI参考的话不方便直接复制,转换成markdown再给AI阅读会更简单明了,也方便自己查阅,这里给大家推荐两个在线的免费HTML转markdown网站。 1、https://d1tools.com/tools/c...

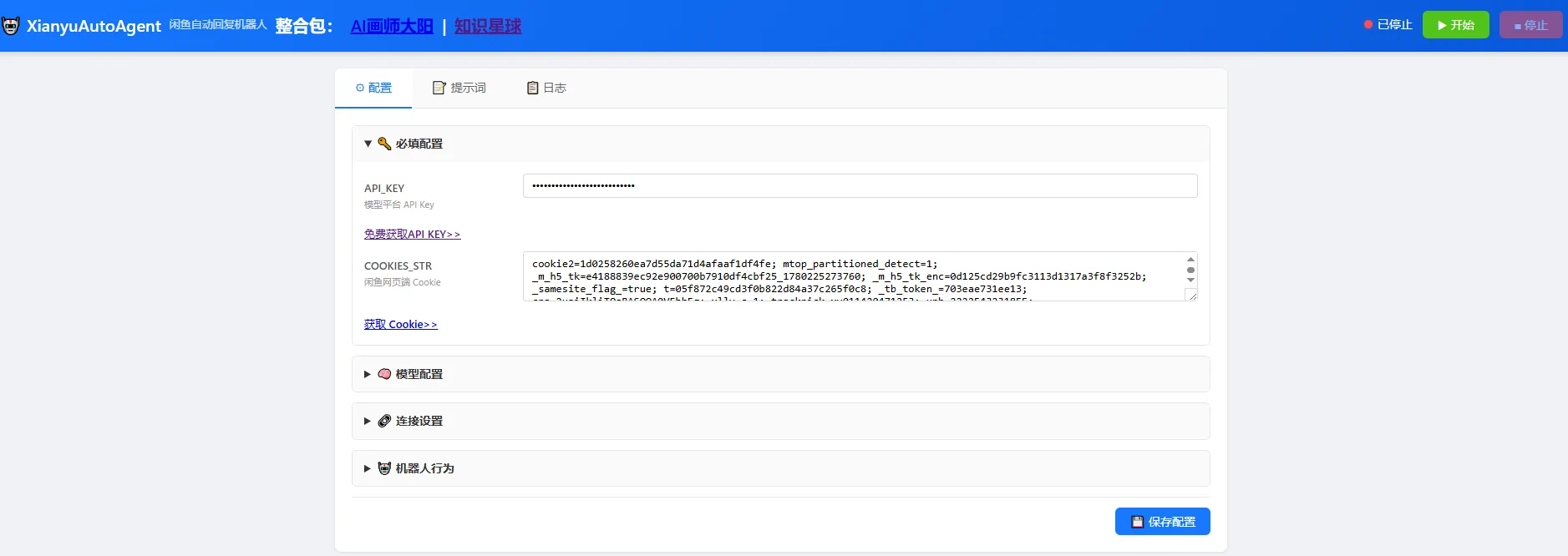

闲鱼自动回复机器人XianyuAutoAgent下载,24小时在线智能客服机器人系统

XianyuAutoAgent是一款面向闲鱼平台的智能化自动回复机器人,利用大语言模型自动识别买家意图并生成专业回复,实现 7×24 小时智能客服。 主要功能 1. 智能自动回复 2. 可视化 Web UI 3. 人工接管模式 4. 安全防...

AI漫剧制作即梦seedance2.0教程及提示词2026年5月最新版分享

AI视频依旧持续火爆,各种类型的AI视频层出不穷,视频效果也是越来越好,甚至快接近影视级,目前最主要的AI视频生成工具还是即梦,即梦 Seedance 2.0生成视频一秒钟都到2块多钱了😂,不过也没办法,还是得用,目前还没能有替代即梦see...

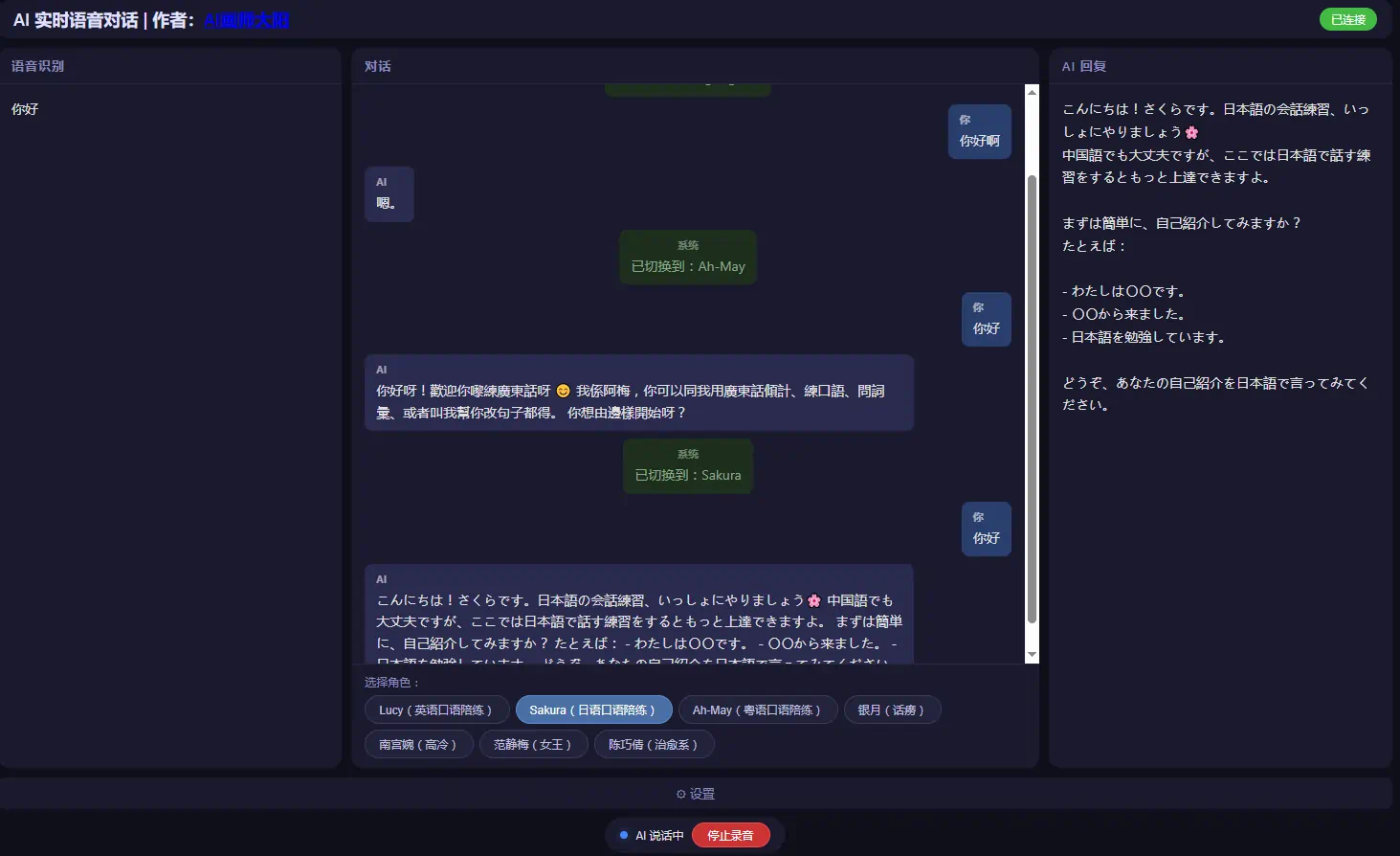

AI实时语音聊天对话系统,外语口语陪练/虚拟好友实时语音交流

AI 实时语音对话系统 是一款集语音识别(ASR)、大语言模型(LLM)对话、语音合成(TTS)于一体的实时语音交互软件。用户通过麦克风说话,系统自动识别语音内容并转为文字,交由 AI 角色进行智能回复,最终将回复内容合成为语音实时播放,实...

ComfyUI 三参考图生图工作流,虚拟试衣、换脸、图片内容整合

本工作流核心能力是将三张不同角度、内容的参考图,通过 AI 理解融合,生成一张新的图像,新图像内容根据描述词指令生成。工作流集成了阿里巴巴的 Qwen2.5-VL 多模态大模型(图像编辑版本)与 SeedVR2 超分辨率放大模型,实现了「理...

comfyui CUDA128+torch 2.8.0+python3.12最新纯净版一键启动整合包

comfyui官方发布的最新版便携包是基于torch 2.11+CU130 +Python 3.13版本制作的,Python版本和torch版本都太新了,windows电脑上安装某些节点的时候会有冲突报错,有时候就算能安装上也会比较麻烦,感...

LTX2.3+comfyui音频驱动视频生成工作流

这是一个基于 ComfyUI 的 LTX 2.3 音视频同步生成工作流,核心功能是上传一段音频 + 参考图片(可多张图),自动生成与音频内容对应的视频,适合制作人物说话、唱歌等口型同步视频。工作流使用8位量化版ltx2.3模型,显存需求降低...

LTX2.3+comfyui分段提示词图片转视频工作流,AI视频带货生成器

再和大家分享一个基于 ComfyUI 的 AI 分段提示词图生视频工作流,本工作流主要基于模型LTX2.3和PromptRelay实现。可使用PromptRelay分时段控制生成不同视频画面或合成语音内容。 📌 工作流简介 本工作流是一套基...

windows电脑C盘垃圾查找清理软件

电脑用了好几年了,尽管我安装软件从来不主动装到C盘,偶尔也会清理垃圾,但是用的久了,容量也是在慢慢减少。我C盘303G,现在就剩了24G了,已经会影响到系统性能和虚拟内存调度了,已经不能不管了。C盘不装软件的话大多都是缓存,文件太多了,有时...

LTX2.3+comfyui视频去除字幕水印工作流分享

本次再和大家分享一个视频去字幕水印的comfyui工作流,工作流基于LTX2.3视频生成模型制作。LTX2.3是最新最强的视频生成模型,我前段时间就分享过了,可以看我另一篇文章:https://nuowa.net/2525,comfyui项...