本次再分享一个非常强大的视觉追踪工具SAMURAI,SAMURAI是一个基于Meta推出的Segment Anything Model 2(SAM 2)的改进版本,旨在实现零样本视觉跟踪,特别关注运动感知记忆的适应性。

SAMURAI介绍

本应用是由华盛顿大学华人团队基于Meta的SAM 2的优化升级版。是 SAMURAI 的官方实现:使用运动感知记忆调整任何分段模型以实现零样本视觉跟踪

主要功能:

- 零样本视觉跟踪:无需额外训练,直接利用SAM 2.1的预训练权重进行视觉对象跟踪。

- 运动感知记忆:通过引入卡尔曼滤波器,增强对目标运动的预测能力,提高在复杂场景中的跟踪准确性。

具体使用场景:

- 复杂视频分析:适用于处理快速移动或被遮挡的目标,如体育比赛、舞蹈表演等场景中的对象跟踪。

- 实时监控:在拥挤或动态环境中,对特定目标进行实时跟踪,提升监控系统的智能化水平。

- 人机交互:在增强现实或虚拟现实应用中,实时跟踪用户或物体的运动,提高交互体验的自然性和流畅度。

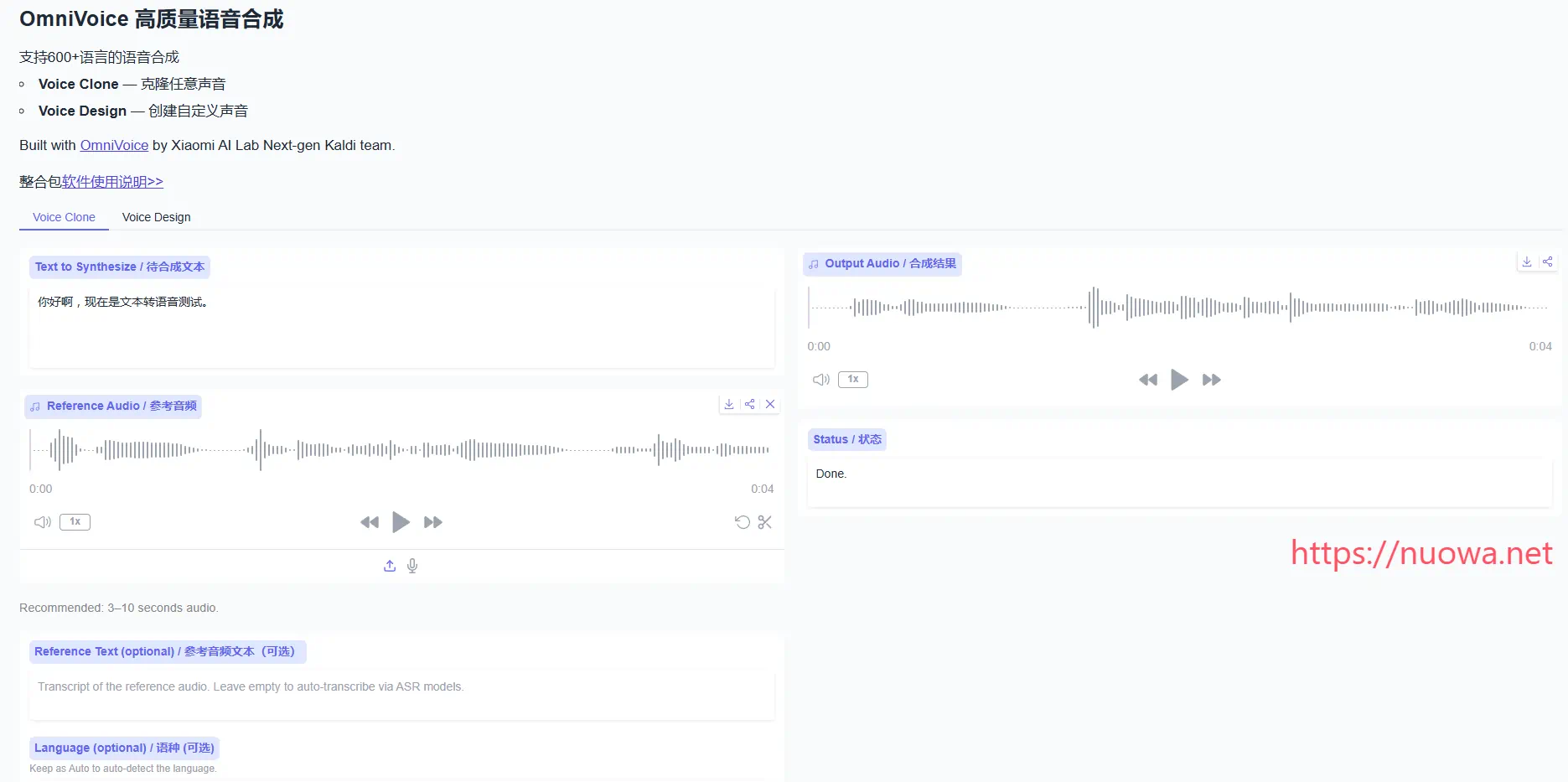

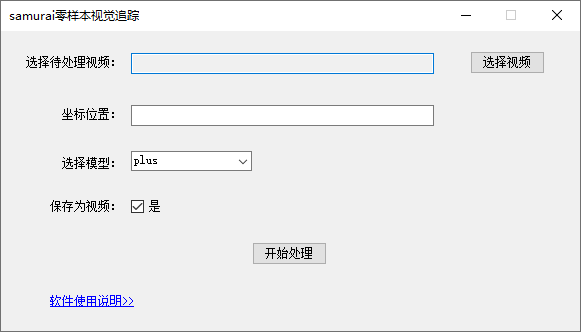

SAMURAI整合包使用说明

首先到网盘内将软件压缩包下载到电脑上解压。SAMURAI无需自己训练模型,直接使用预训练模型即可。我没有打包模型文件而是做了个模型下载程序,首先运行【模型下载.exe】即可从阿里平台满速下载模型,速度非常快,等到终端窗口界面输出提示模型下载完成即可。

模型下载完成后即可双击运行【启动软件.exe】启动软件操作界面。软件支持处理视频文件和图片序列。你可以将mp4视频文件或是文件夹鼠标左键按住拖动到软件窗口里,软件会自动识别路径并填充到编辑框中。

坐标位置:你需要提供所追踪物体在视频第一帧中的坐标位置,追踪区域为方形,坐标位置的值类似:100,101,102,103。前两个值是这个区域最左上角的顶点的坐标。后两个值是这个区域的宽高尺寸。数值之间使用英文逗号“,”隔开。如果你没有相关获取视频内物体坐标位置的工具的话,你可以看我下面这篇文章参考获取视频内物体坐标位置和尺寸《使用QQ和PotPlayer确定视频中指定区域点的坐标位置和宽高尺寸》

模型选择:理论模型越大效果越好,默认使用plus模型,想要体验更大模型效果的话可以选择large。

点击开始处理按钮即可开始处理视频。等到软件处理完成后会将输出结果视频output.mp4保存到软件项目文件夹内。

处理速度主要受视频尺寸影响,视频尺寸越大处理越慢。

注意事项

开始处理后会首先占用大量CPU和内存,感觉至少应该要预留15G内存,如果内存不足会报not enough memory相关错误。

整合包只支持Windows 10或11系统

软件运行路径中不要有非英文字符和空格

使用前请先将英伟达显卡驱动更新到最新版本,否则可能会报错

建议英伟达显卡显存6G以上用户体验

零样本视觉追踪软件samurai一键启动包下载链接

相关推荐

视频人物物体运动视觉追踪定位软件SAMURAI整合包使用说明视频教程

视频人物物体运动视觉追踪定位软件SAMURAI整合包使用说明视频教程 BiliNote:自动生成B站油管视频笔记,AI视频内容总结工具

BiliNote:自动生成B站油管视频笔记,AI视频内容总结工具 优云智算HappyHorse AI 视频生成API KEY WebUI

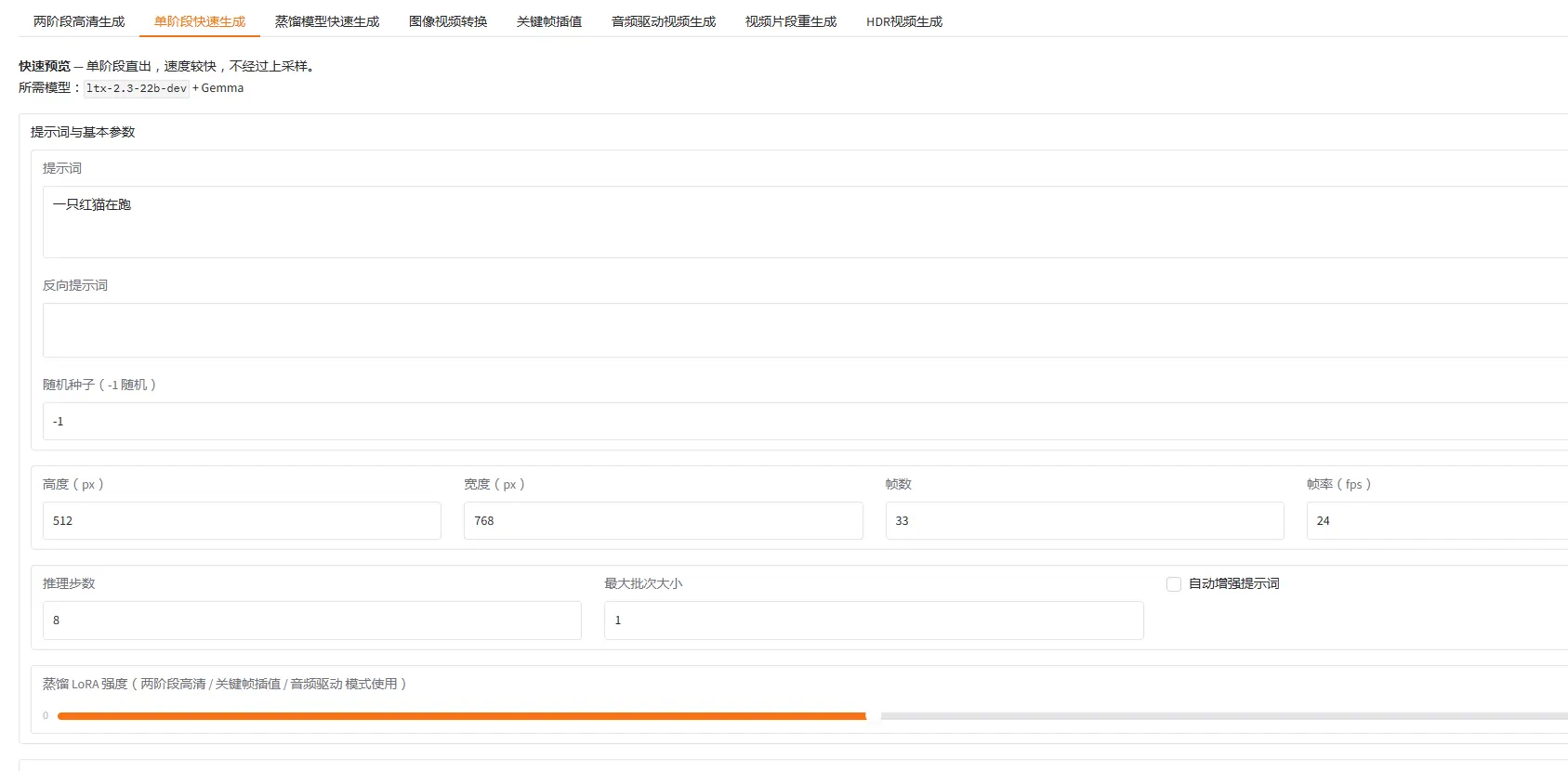

优云智算HappyHorse AI 视频生成API KEY WebUI LTX-2.3 视频生成免安装部署整合包软件下载

LTX-2.3 视频生成免安装部署整合包软件下载 FlashVSR低分辨率模糊视频高清放大工具整合包v1.1下载,免安装一键启动

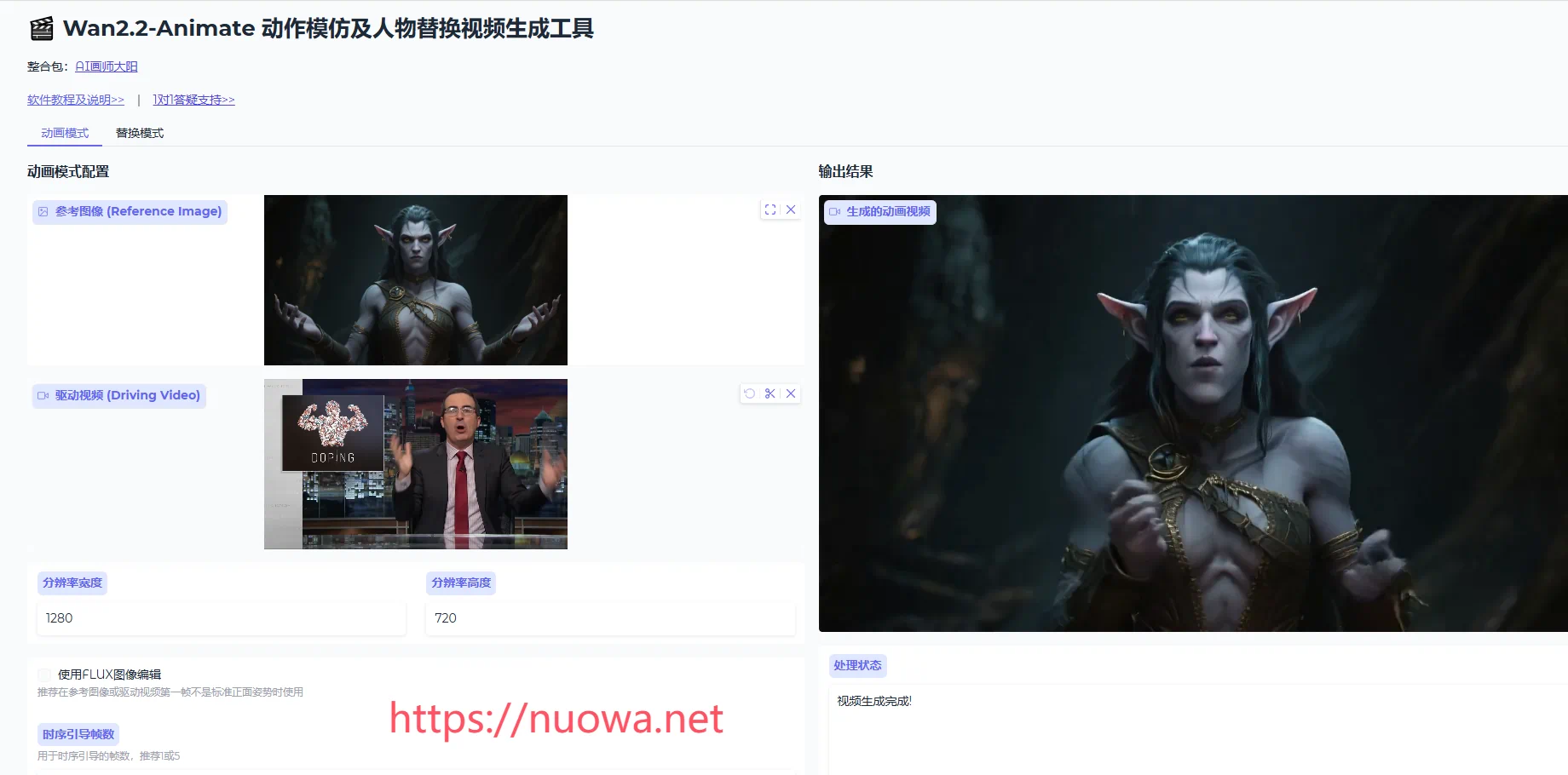

FlashVSR低分辨率模糊视频高清放大工具整合包v1.1下载,免安装一键启动 人物动作迁移及视频人物替换软件Wan2.2-Animate-14B整合包下载,动作模仿视频换主体工具在线一键启动

人物动作迁移及视频人物替换软件Wan2.2-Animate-14B整合包下载,动作模仿视频换主体工具在线一键启动 无限长度的数字人对话视频生成软件InfiniteTalk整合包,图像转视频、视频配音对口型工具

无限长度的数字人对话视频生成软件InfiniteTalk整合包,图像转视频、视频配音对口型工具 Wan2.2-S2V-14B:音频驱动图片转视频生成本地整合包及在线一键启动

Wan2.2-S2V-14B:音频驱动图片转视频生成本地整合包及在线一键启动

最近更新

Claude居然自称“本人”

今天在和Claude聊网文写作的时候,Claude回复中居然自称本人,这让我有点震惊。 我经常会和AI聊工具功能对比等话题,ChatGPT、Gemini、Claude这些以前我记得从来没有自称过本人的,好像都是本模型,本工具等等,反正从来没...

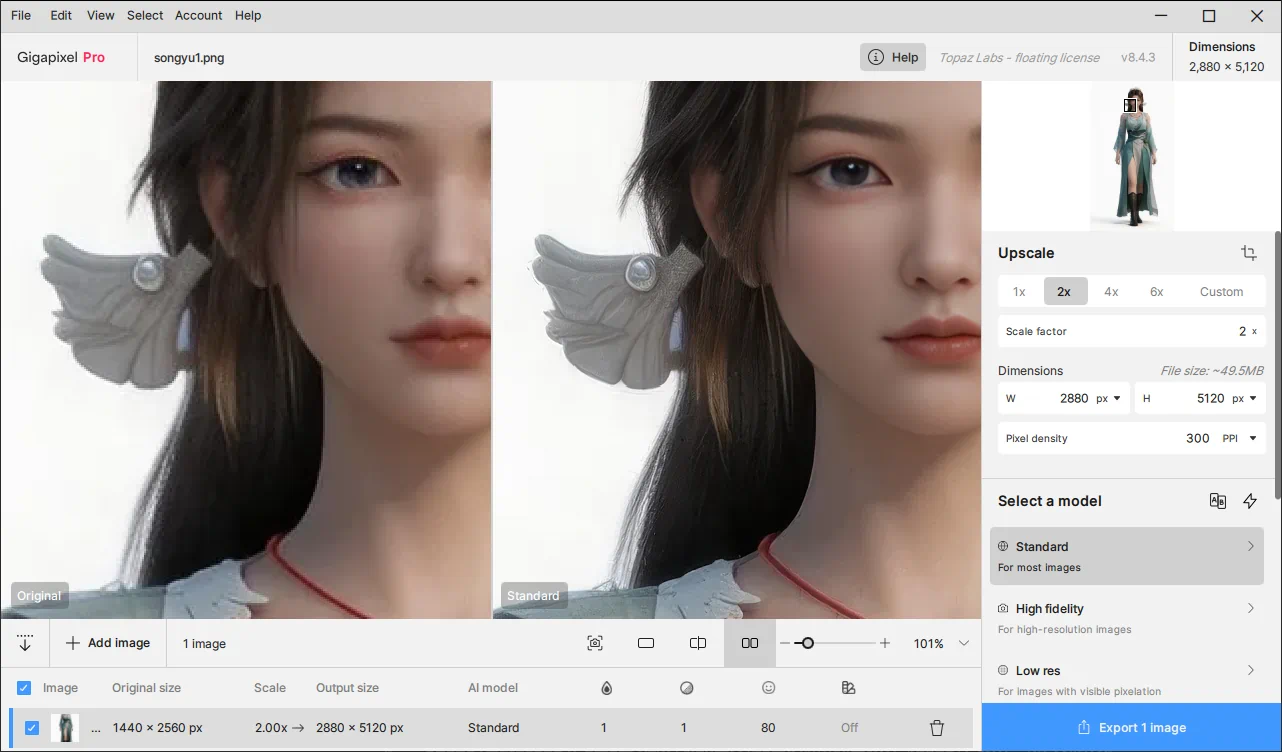

图像无损放大神器:Topaz Gigapixel AI软件下载及使用指南

在数字内容创作成风头的今天,我们经常会遇到低分辨率素材模糊、AI 生成图片尺寸太小、或者老照片充满噪点的情况。传统的图像放大方式(如双三次插值)只是单纯地拉伸像素,容易让画面变得模糊、虚化。 如果你正在寻找一种能“凭空”补齐细节、让低画质瞬...

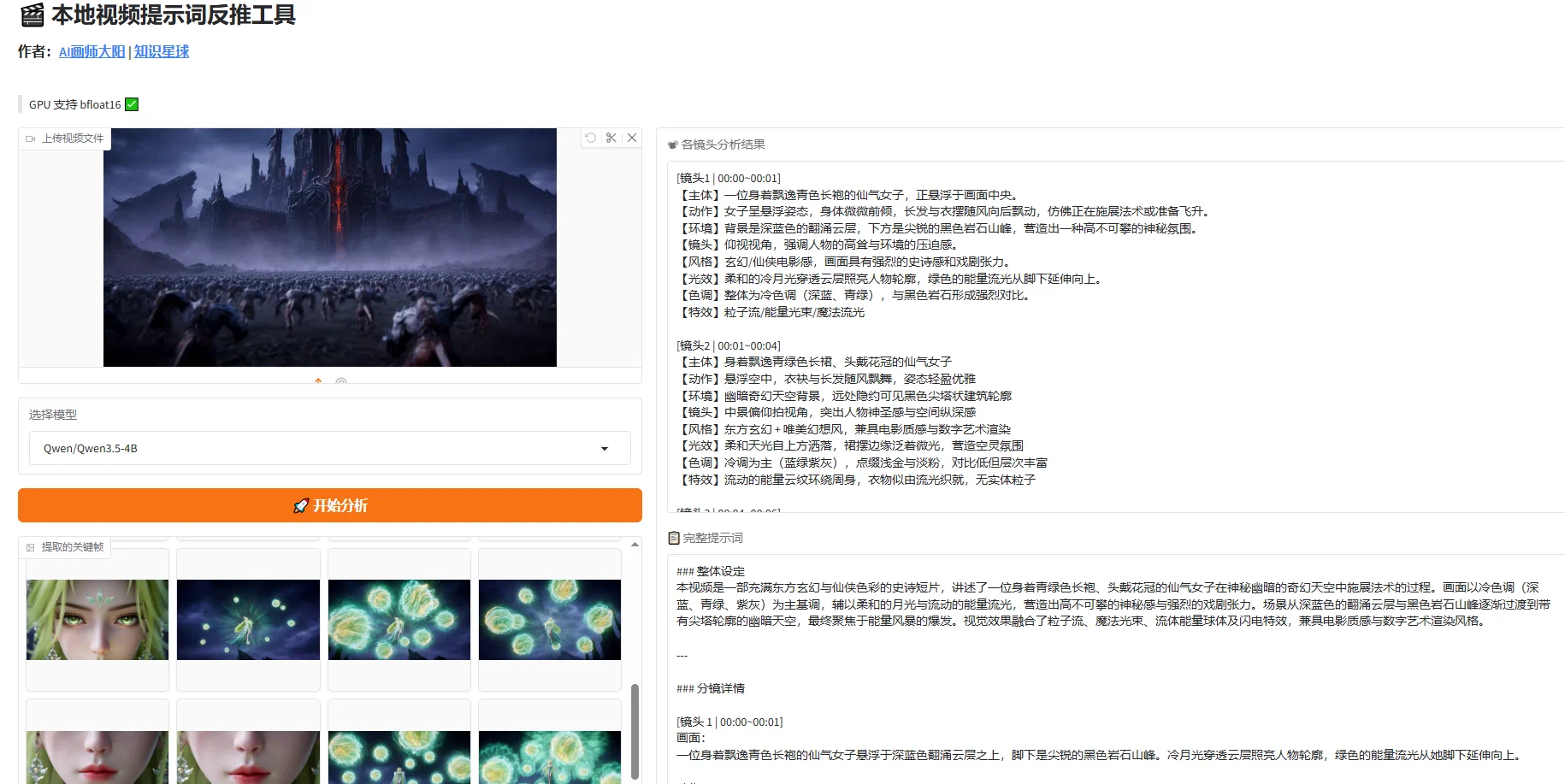

AI视频提示词反推工具,参考视频即梦提示词一键生成

本工具是一款面向 AI 视频生成创作者的本地离线辅助软件。用户导入任意视频文件,工具会自动完成场景检测、关键帧提取、多模态模型分析、提示词拼装等全流程,最终输出一份可直接复制粘贴到即梦 AI 等视频生成平台的完整提示词。 适用场景 功能特点...

免费在线HTML转markdown工具

经常看一些在线文档,想复制给AI参考的话不方便直接复制,转换成markdown再给AI阅读会更简单明了,也方便自己查阅,这里给大家推荐两个在线的免费HTML转markdown网站。 1、https://d1tools.com/tools/c...

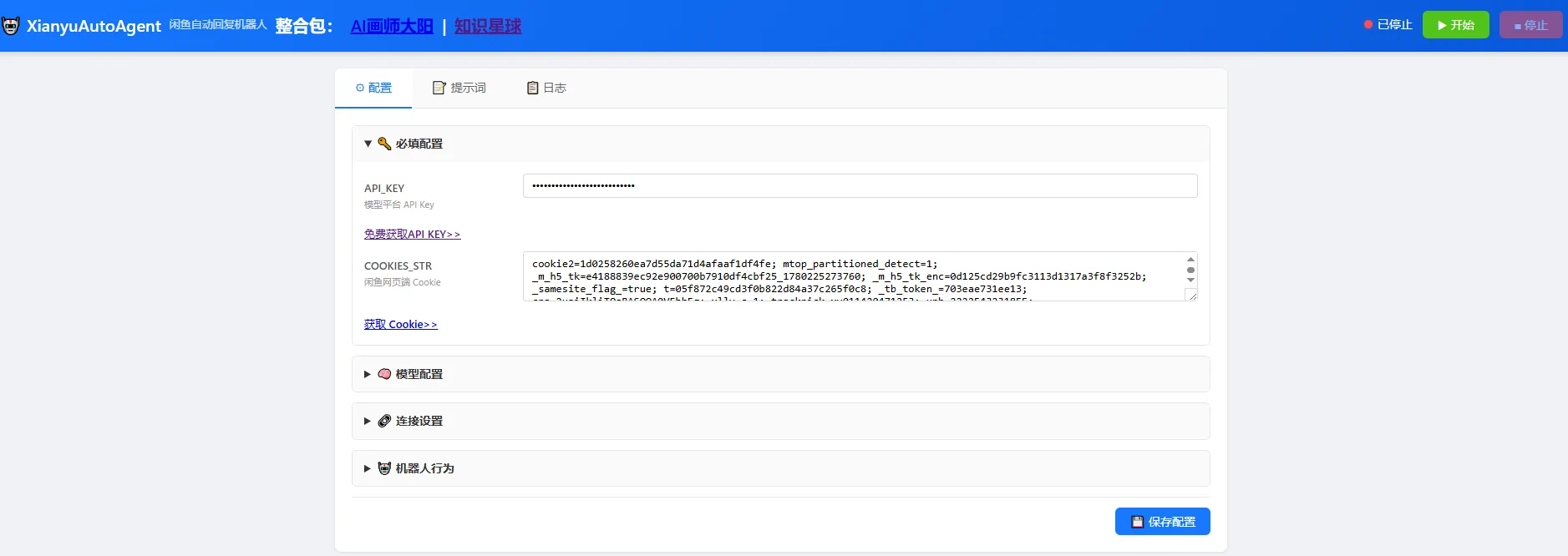

闲鱼自动回复机器人XianyuAutoAgent下载,24小时在线智能客服机器人系统

XianyuAutoAgent是一款面向闲鱼平台的智能化自动回复机器人,利用大语言模型自动识别买家意图并生成专业回复,实现 7×24 小时智能客服。 主要功能 1. 智能自动回复 2. 可视化 Web UI 3. 人工接管模式 4. 安全防...

AI漫剧制作即梦seedance2.0教程及提示词2026年5月最新版分享

AI视频依旧持续火爆,各种类型的AI视频层出不穷,视频效果也是越来越好,甚至快接近影视级,目前最主要的AI视频生成工具还是即梦,即梦 Seedance 2.0生成视频一秒钟都到2块多钱了😂,不过也没办法,还是得用,目前还没能有替代即梦see...

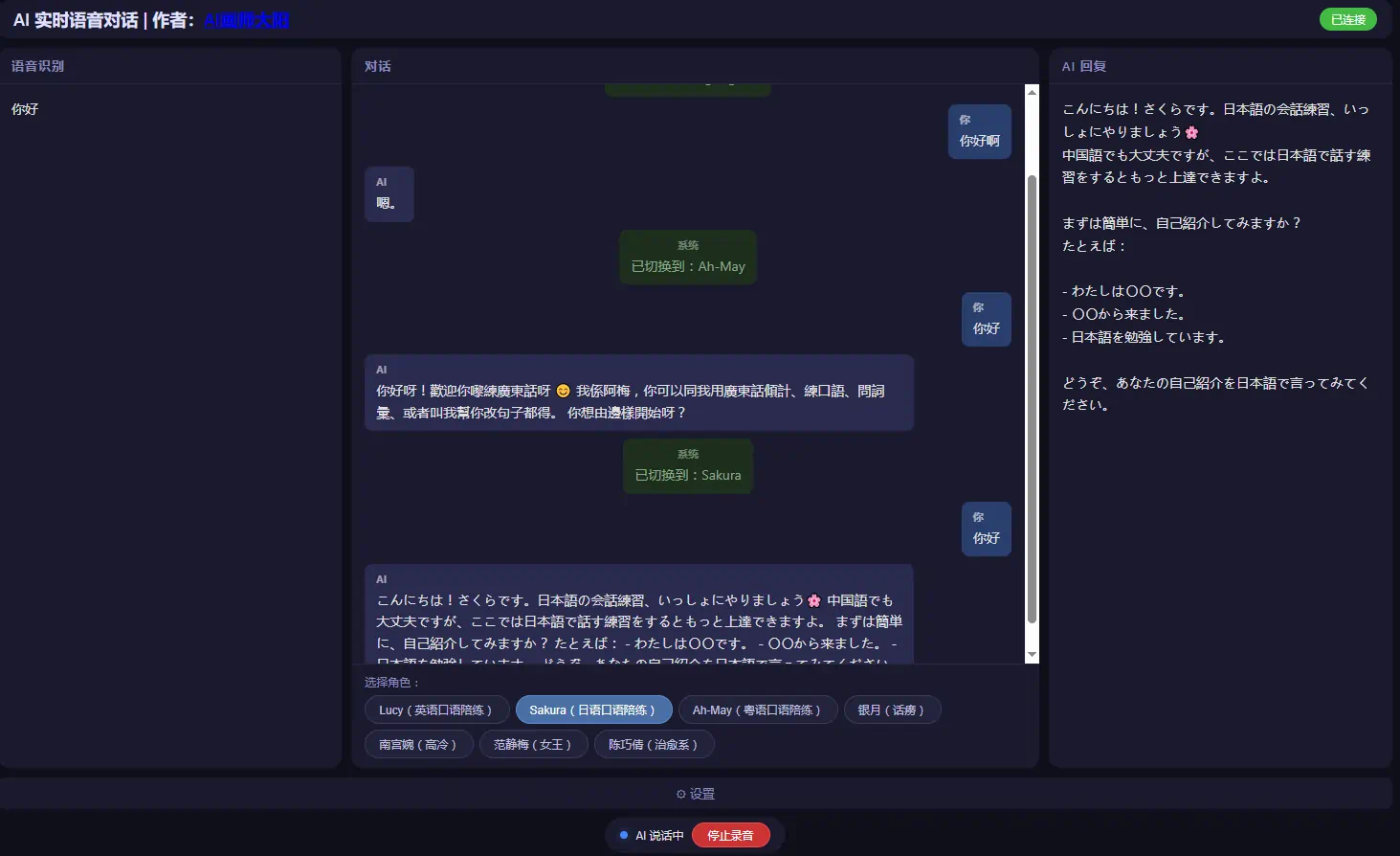

AI实时语音聊天对话系统,外语口语陪练/虚拟好友实时语音交流

AI 实时语音对话系统 是一款集语音识别(ASR)、大语言模型(LLM)对话、语音合成(TTS)于一体的实时语音交互软件。用户通过麦克风说话,系统自动识别语音内容并转为文字,交由 AI 角色进行智能回复,最终将回复内容合成为语音实时播放,实...

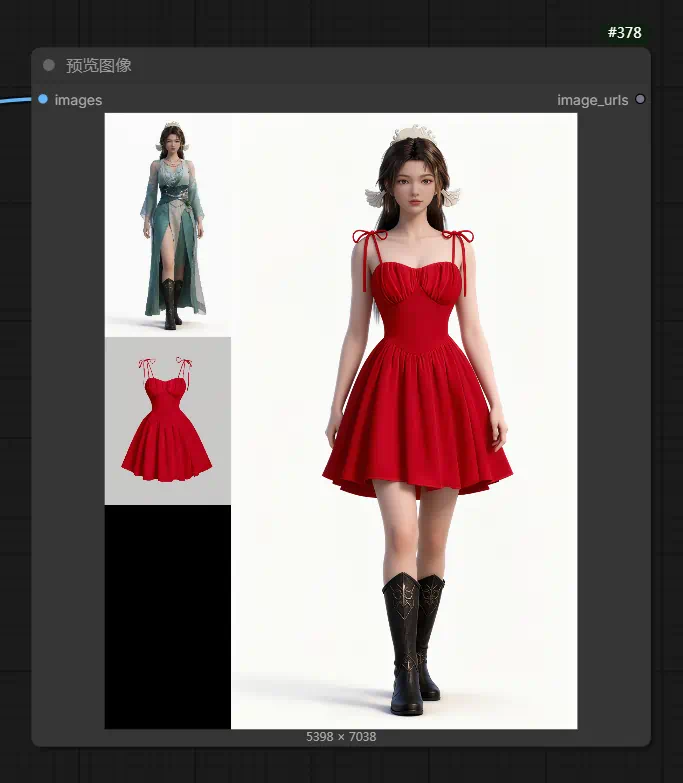

ComfyUI 三参考图生图工作流,虚拟试衣、换脸、图片内容整合

本工作流核心能力是将三张不同角度、内容的参考图,通过 AI 理解融合,生成一张新的图像,新图像内容根据描述词指令生成。工作流集成了阿里巴巴的 Qwen2.5-VL 多模态大模型(图像编辑版本)与 SeedVR2 超分辨率放大模型,实现了「理...

comfyui CUDA128+torch 2.8.0+python3.12最新纯净版一键启动整合包

comfyui官方发布的最新版便携包是基于torch 2.11+CU130 +Python 3.13版本制作的,Python版本和torch版本都太新了,windows电脑上安装某些节点的时候会有冲突报错,有时候就算能安装上也会比较麻烦,感...

LTX2.3+comfyui音频驱动视频生成工作流

这是一个基于 ComfyUI 的 LTX 2.3 音视频同步生成工作流,核心功能是上传一段音频 + 参考图片(可多张图),自动生成与音频内容对应的视频,适合制作人物说话、唱歌等口型同步视频。工作流使用8位量化版ltx2.3模型,显存需求降低...